ChatGPT pourrait très bien réécrire le Cogito de Descartes, mais alors en imitant seulement son style, sans prendre lui-même la décision de sortir du rapport habituel à la réalité, et sans mettre en œuvre le travail intellectuel par lequel cette décision devient opératoire. Il n’est pas capable de produire des idées, car l’idée n’est pas « une peinture muette sur un panneau ». « L’idée, mode du penser ne consiste ni dans l’image de quelque chose, ni dans les mots », disait Spinoza dans l’Ethique.

ChatGPT est un système qui, s'il ne peut directement accéder au web puisqu'il repose sur une base de données qui contient le fruit de ce qui fut un apprentissage profond via la méthode du DeepLearning à partir d'un jeu de données de plusieurs centaines de GO (environ 500GO à la base, ce qui reste modeste, mais ce jeu de données augmentera via des mises à jour et un entraînement permanent). D'autre part, ce système est "ouvert" et également entraîné/supervisé à l'aide de personnels humains, employés pour ça. Ils servent notamment à vérifier son bon fonctionnement, le respect des principes liés à une éthique, ils "policent" le système. Bien sûr, je résume grossièrement une réalité plus complexe et nuancée.

Cela pour dire : le "réel" de ChatGPT, c'est quoi ? Ce ne sont pas des mots, non. Ce sont des milliards de vecteurs multidimensionnels.

On peut traduire par "des possibles computationnels déterministes et probabilistes". Là dedans, il n'y a pas de pensée. Aucune pensée. Juste un miroir qui réfléchit la lumière qu'on lui envoie. C'est le principe d'un automate simplement hautement sophistiqué. Ce qui vous répond est une illusion.

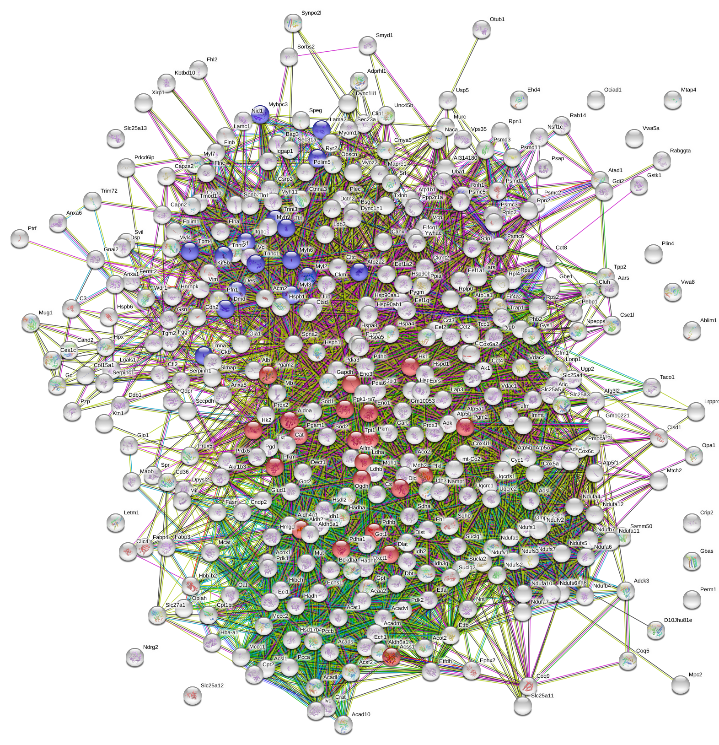

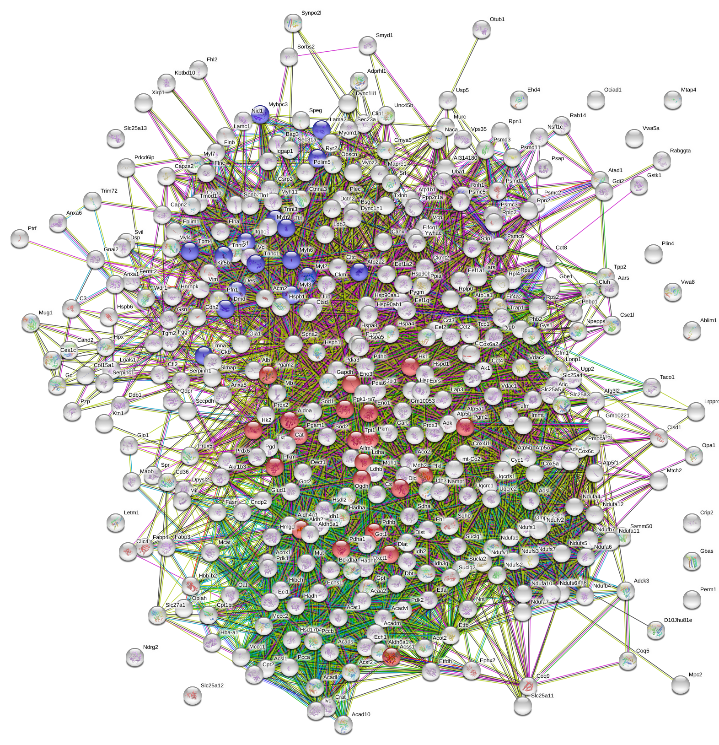

Une illustration pour visualiser ce type d'espace vectoriel QUI N'EST PAS ISSU du modèle de ChatGPT, il s'agit simplement d'une représentation de ce qui ne montrerait là qu'une infime partie "d'un grand tout".

Une illustration pour visualiser ce type d'espace vectoriel QUI N'EST PAS ISSU du modèle de ChatGPT, il s'agit simplement d'une représentation de ce qui ne montrerait là qu'une infime partie "d'un grand tout".

ChatGPT est incapable de "rêver de moutons électriques" (pour ceux qui connaissent la référence).

En cela, il est absurde de chercher la comparaison avec ce que furent, et sont les plus grands penseurs issus de notre humanité.

Il n'en reste pas moins un outil impressionnant et pour peu que l'on sache correctement l'employer, peut se révéler être utile. Il ne s'agit donc pas d'un gadget. C'est un outil fonctionnel et exploitable. Mais ça ne reste qu'un miroir qui ne fait que réfléchir la lumière qu'on lui envoie. Un miroir qui ne pense pas. Qui ne cogite pas. Chez ChatGPT,

Il n'y a pas de "permanence" propre à l'état d'être vivant, et chez l'humain d'éprouver cette conscience.

« La machine d’arithmétique fait des effets qui approchent plus de la pensée que tout ce que font les animaux ; mais elle ne fait rien qui puisse faire dire qu’elle a de la volonté, comme les animaux ».

Il faut prendre pour acquis que nous-mêmes sommes des animaux. Certes, "des animaux qui pensent qu'ils pensent", et parce que nous pensons que nous pensons, nous nous prétendons conscients, mais nous n'en restons pas moins du règne animal, qu'on le veuille ou non, c'est établi. Définir le principe de conscience comme étant proprement humain serait une erreur fondamentale. Certes, l'Homme se sait vivant, mais il le sent aussi. Nous pourrions présupposer que l'animal se sent vivant, mais le sait-il ? Par principe, en dehors de notre espèce, les animaux ne peuvent pas nous répondre. Une piste : nous sommes des animaux.

Malgré tout, la pensée humaine s'extrait pour vouloir s'échapper du principe animal. Mais une espèce animale pense-t-elle comme une autre ?

La pensée n'est pas le mot, elle éprouve le monde, elle ressent. Chaque espèce a sa manière de penser, l'intelligence est propre à chaque espèce animale, parfaitement adaptée et au plus haut stade de son évolution.

La volonté ou le principe de survie.

La nature ne connait pas de morale. Pourrait-on la qualifier de cruelle, au regard de nos belles valeurs. Cette cruauté, nous la portons en nous, mieux, nous l'avons totalement assimilée à nos sociétés. Chaque société issue de la civilisation humaine porte une part de cruauté, plus ou moins établie selon les cultures. En France, bien sûr, nous n'en réchappons pas. La République est un idéal, sensée nous protéger, tous les enfants de la République. Mais en réalité, pour peu que l'on ouvre les yeux, au coin de la rue, nous pouvons trouver sans beaucoup chercher les stigmates propres à cette cruauté, dite naturelle, et qui nous démontre chaque jour à quel point, en dépit de notre humanité, nous sommes surtout des animaux. Les uns roulent sur le malheur des autres, parfois via des procédures institutionnelles, les autres passent devant, sans même poser un regard. Pas même un sourire.

Animal, jusqu'au bout de notre humanité.

Avant de penser une machine qui pense qu'elle pense, il conviendrait mieux de savoir nous remettre à notre juste place, et peut-être de panser nos plaies.

(à suivre...)